Groot taalmodelle het onlangs massiewe prominensie verwerf nadat hul hoogs bekwame gebruiksgeval ChatGPT oornag 'n sukses geword het. Met die sukses van ChatGPT en ander ChatBots het 'n menigte mense en organisasies belanggestel om die tegnologie wat sulke sagteware aandryf, te verken.

Groot taalmodelle is die ruggraat agter hierdie sagteware wat die werking van verskeie natuurlike taalverwerkingstoepassings moontlik maak, soos masjienvertaling, spraakherkenning, vraagbeantwoording en teksopsomming. Kom ons leer meer oor LLM en hoe jy dit kan optimaliseer vir die beste resultate.

Wat is groot taalmodelle of ChatGPT?

Groot taalmodelle is masjienleermodelle wat kunsmatige neurale netwerke en groot silo's data gebruik om NLP-toepassings aan te dryf. Met opleiding op groot hoeveelhede data, kry LLM die vermoë om verskeie kompleksiteite van natuurlike taal vas te lê, wat dit verder gebruik het vir:

- Generering van nuwe teks

- Opsomming van artikels en gedeeltes

- Onttrekking van data

- Herskryf of parafraseer die teks

- Klassifikasie van data

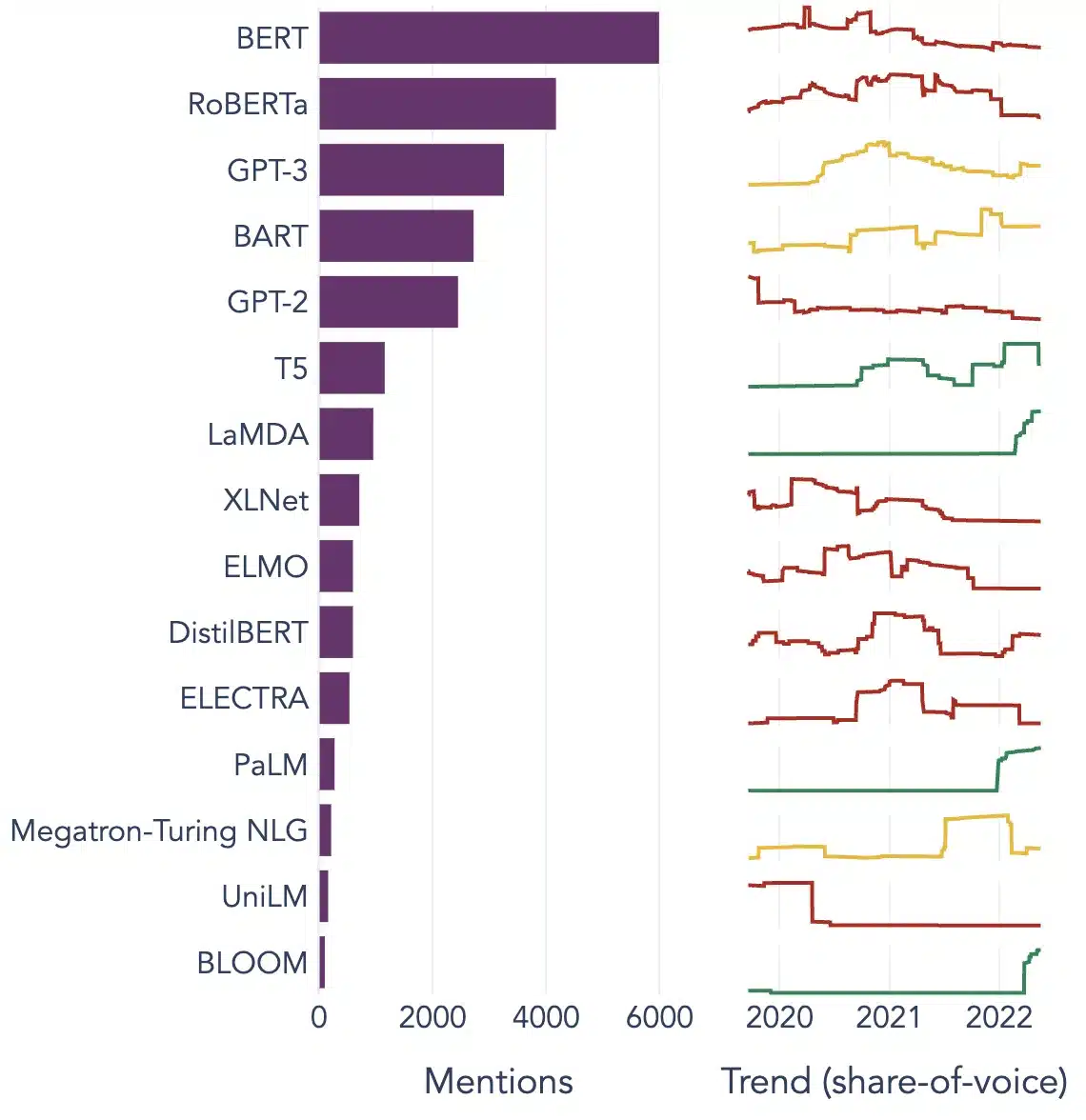

Sommige gewilde voorbeelde van LLM is BERT, Chat GPT-3 en XLNet. Hierdie modelle is opgelei op honderde miljoene tekste en kan waardevolle oplossings bied vir alle soorte afsonderlike gebruikersnavrae.

Gewilde gebruiksgevalle van groot taalmodelle

Hier is 'n paar van die top en mees algemene gebruiksgevalle van LLM:

Teks Generasie

Groot taalmodelle maak gebruik van kunsmatige intelligensie en rekenaarlinguistiekkennis om outomaties natuurlike taaltekste te genereer en verskeie kommunikatiewe gebruikersvereistes te voltooi soos om artikels, liedjies te skryf of selfs met die gebruikers te gesels.

Masjienvertaling

LLM's kan ook gebruik word om teks tussen enige twee tale te vertaal. Die modelle maak gebruik van diepleeralgoritmes, soos herhalende neurale netwerke, om die taalstruktuur van die bron- en teikentale aan te leer. Gevolglik word hulle gebruik om bronteks in die doeltaal te vertaal.

Inhoudskepping

LLM's het dit nou vir masjiene moontlik gemaak om samehangende en logiese inhoud te skep wat gebruik kan word om blogplasings, artikels en ander vorme van inhoud te genereer. Die modelle gebruik hul uitgebreide diepleerkennis om die inhoud in 'n unieke en leesbare formaat vir die gebruikers te verstaan en te struktureer.

Sentimentanalise

Dit is 'n opwindende gebruiksgeval van Groottaalmodelle waarin die model opgelei word om emosionele toestande en sentimente in benoemde teks te identifiseer en te klassifiseer. Die sagteware kan emosies soos positiwiteit, negatiwiteit, neutraliteit en ander komplekse sentimente opspoor wat kan help om insigte te kry in kliënte se menings en resensies oor verskillende produkte en dienste.

Begrip, opsomming en klassifikasie van teks

LLM's bied 'n praktiese raamwerk vir die KI-sagteware om die teks en sy konteks te verstaan. Deur die model op te lei om groot hope data te verstaan en te ontleed, stel LLM KI-modelle in staat om teks in verskillende vorme en patrone te verstaan, op te som en selfs te klassifiseer.

Vraag beantwoord

Groot taalmodelle stel QA-stelsels in staat om 'n gebruiker se natuurlike taalnavraag akkuraat op te spoor en daarop te reageer. Een van die gewildste toepassings van hierdie gebruiksgeval is ChatGPT en BERT, wat die konteks van 'n navraag ontleed en deur 'n groot korpus tekste soek om relevante antwoorde op gebruikersnavrae te vind.

[Lees ook: Die toekoms van taalverwerking: groot taalmodelle en -voorbeelde ]

3 noodsaaklike voorwaardes om LLM's suksesvol te maak

Die volgende drie voorwaardes moet akkuraat nagekom word om die doeltreffendheid te verbeter en jou groottaalmodelle suksesvol te maak:

Teenwoordigheid van enorme hoeveelhede data vir modelopleiding

LLM benodig groot hoeveelhede data om modelle op te lei wat doeltreffende en optimale uitkomste bied. Daar is spesifieke metodes, soos oordragleer en self-toesig vooropleiding, wat die LLM's gebruik om hul prestasie en akkuraatheid te verbeter.

Bou lae van neurone om komplekse patrone vir die modelle te fasiliteer

'n Groot Taalmodel moet verskeie lae neurone bevat wat spesiaal opgelei is om die ingewikkelde patrone in data te verstaan. Neurone in dieper lae kan komplekse patrone beter verstaan as vlakker lae. Die model kan die assosiasie tussen woorde, die onderwerpe wat saam verskyn, en die verband tussen dele van spraak leer.

Optimalisering van LLM's vir gebruikerspesifieke take

LLM's kan aangepas word vir spesifieke take deur die aantal lae, neurone en aktiveringsfunksies te verander. Byvoorbeeld, 'n model wat die volgende woord in die sin voorspel, gebruik gewoonlik minder lae en neurone as 'n model wat ontwerp is om nuwe sinne van nuuts af te genereer.

Gewilde voorbeelde van groot taalmodelle

Hier is 'n paar prominente voorbeelde van LLM's wat wyd in verskillende industrie-vertikale gebruik word:

Image Bron: Op pad na datawetenskap

Gevolgtrekking

LLM's sien die potensiaal om NLP te revolusioneer deur robuuste en akkurate taalverstaanvermoëns en oplossings te verskaf wat 'n naatlose gebruikerservaring bied. Om LLM'e egter doeltreffender te maak, moet ontwikkelaars hoëgehalte-spraakdata gebruik om meer akkurate resultate te genereer en hoogs effektiewe KI-modelle te produseer.

Shaip is een van die voorste KI-tegnologie-oplossings wat 'n wye verskeidenheid spraakdata in meer as 50 tale en verskeie formate bied. Kom meer te wete oor LLM en neem leiding oor jou projekte van Shaip kenners vandag.